라이뷰

ChatGPT 이전의 세계, 이후의 세계

ChatGPT 이모저모 - 서론 및 기술적 원리 개괄

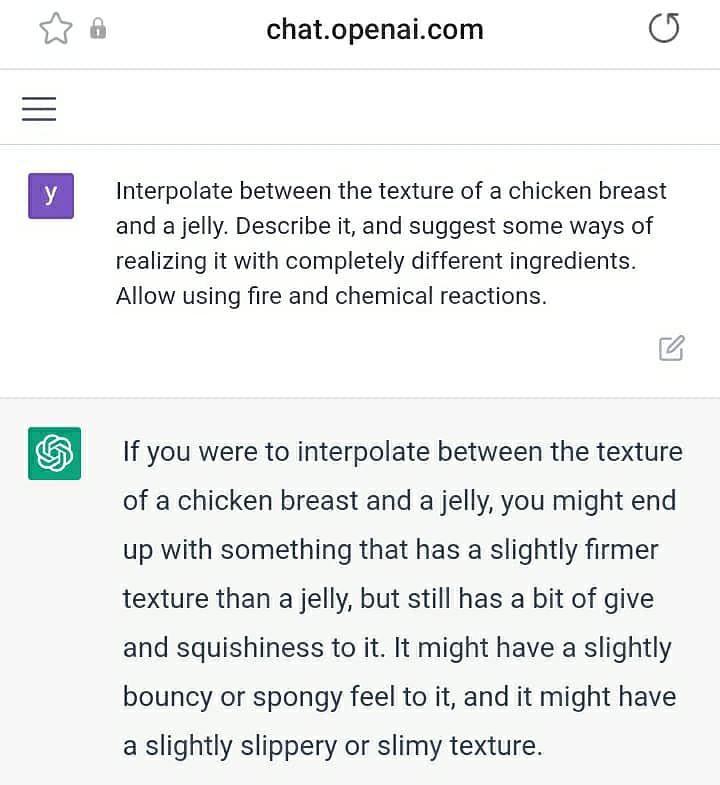

대화형 인공지능 ChatGPT를 처음 접한 것은 작년 12월 초였는데, 당시에 워낙 높은 성능과 창의적인 과제 수행 덕분에 하루종일 이것만 가지고 놀게 되는 등, 걱정스러울 정도로 재미있는 바람에 하루이틀 시험하다가 오히려 심리적 거리를 두고 접어 두었었다. 그때 열심히 사용해 보고, 보다 최근에 큰 화제가 된 후 다시 사용해보며 느낀 점들을 정리해 보고자 한다. 작동 원리에 대한 이야기는 가장 단순화된 레벨에서는 아마 대체로 정확할 테지만, 기술적인 세부는 맥락에 다소 어긋나거나 부정확할 수도 있다. 따라서 이번 포스트를 제외한 이 시리즈의 내용 대다수는 실제 기술적인 원리보다는, 철저히 사용자 입장에서 느낀 점을 다룰 것이다.

또한 이 글을 작성하는 사이에 이미 ChatGPT뿐만 아니라 각 유수 기업에 의한 대화형 거대언어모델들도 속속 공개되었고, 각 부문에 특화된 서비스들도 구름떼처럼 등장하고 있다. 특히 가장 최근에는 거대언어모델이 검색엔진 Bing에 결합되어서 실시간 정보도 처리해 주면서, 정말로 검색을 효과적으로 보완하는 역할을 시범적으로 해주고 있다. 또한 바로 며칠 전인 3월 1일에는 ChatGPT의 API가 공개되어, 정식 버전이 여러 가지 서비스에 활발하게 이식될 길이 열렸다. 또한 12월 초에 공개되었을 때에 비해서 쿼리를 처리하는 비용을 90% 이상 절약했다고 한다.

또한 이 글을 작성하는 사이에 이미 ChatGPT뿐만 아니라 각 유수 기업에 의한 대화형 거대언어모델들도 속속 공개되었고, 각 부문에 특화된 서비스들도 구름떼처럼 등장하고 있다. 특히 가장 최근에는 거대언어모델이 검색엔진 Bing에 결합되어서 실시간 정보도 처리해 주면서, 정말로 검색을 효과적으로 보완하는 역할을 시범적으로 해주고 있다. 또한 바로 며칠 전인 3월 1일에는 ChatGPT의 API가 공개되어, 정식 버전이 여러 가지 서비스에 활발하게 이식될 길이 열렸다. 또한 12월 초에 공개되었을 때에 비해서 쿼리를 처리하는 비용을 90% 이상 절약했다고 한다.

.jpg)

@오용재 죄송하다뇨 당치도 않습니다. 이런 좋은 글을 작성해 주시는것만으로도 감사드리죠! 앞으로도 ai 관련해서 많은 좋은 글 작성 부탁드립니다 :)

@messy92 안녕하세요 흥미롭게 읽어주셔서 감사합니다. 지적해주신 점이 맞습니다..! 말씀대로 GPT-3를 학습시킨건 MLM 기반이 아니라고 알고있는데, 구글링해서 찾은 여러 테크블로그 아티클들에서 ChatGPT에 MLM을 썼다고 이야기하길래 ChatGPT를 만드는 파인튜닝 단계에서 그런 걸 썼겠거니 하고 간단히 언급했는데 아마 근거가 부족했던것 같습니다.

실제로 InstructGPT와 ChatGPT 소개 페이지에서도 MLM이 언급되거나 하지는 않기때문에 현재 말씀하신 의심에 대해 정확히 알기는 어려운것 같습니다. 그 테크블로그들에서의 언급은 말씀해주신 의심과 관련이 있다기보다는, 그냥 아마 ChatGPT가 매우 유명해지면서 NLP 전반을 소개하는데, ChatGPT에 대한 specific한 설명과 구분을 잘 안하고 서술했을 뿐인 것 같습니다 (제 글의 해당 부분도 그중 하나이겠고요). 아무튼 좋은 코멘트 주셨는데 다소 허무한 답변이 되어서 죄송합니다.

안녕하세요. ChatGPT를 지탱하는 기술적인 세부요소들에 대해 이런저런 정보를 구하다가 여기까지 찾아왔습니다. 작성해 주신글 매우 재미있게 잘 읽었습니다. 다름이 아니고, 혹시 ChatGPT 구현에 masked language modeling이 활용되었다는 본문 내용의 출처를 알 수 있을까요? 제가 알기로 GPT (Generative Pretrained Transformer)는 autoregressive하게 예측을 수행하는 일반적인 language modeling으로 구현되는 것으로 알고 있습니다. 한편, 이러한 language model을 reinforcement learning (with human feedback)을 통해 reward-signal 기반으로 fine-tuning 할 경우, 그 난이도가 매우 높아 non-autoregressive하게 구현하는 것이 훨씬 수월하고, 따라서 masked language modeling이 선호되는 것으로 알고 있습니다. 이에 따라, 혹시나 ChatGPT의 개발 매커니즘에 내부적으로 masked language modeling이 구현되어 있는 것은 아닌지 의심하던 찰나에 여기까지 흘러들어와 작성자님 글을 보게되었네요.ㅎㅎ 괜찮으시다면 MLM 파트에 대한 출처를 공유해 주시면 감사하겠습니다. :)

용용!

기술적 원리나 학습과정에 대해 충분히 전문적이지 않을까 우려하셨지만 이미 필요한 직관이 잘 담겨있다고 생각하고, 이후 이어지는 글에 나올 여러 활용 예와 거기서 얻은 해석까지 더하면 깊은 이해에 해당하지 않나 합니다!

물론 '온도'와 관련해 이 분야에서 통계물리의 근본력을 이야기하는 데에 한 문단이 통으로 나온 건 여전히 좀 급발진같지만 이것도 용선생 그 자체라 웃음포인트.

용용!

기술적 원리나 학습과정에 대해 충분히 전문적이지 않을까 우려하셨지만 이미 필요한 직관이 잘 담겨있다고 생각하고, 이후 이어지는 글에 나올 여러 활용 예와 거기서 얻은 해석까지 더하면 깊은 이해에 해당하지 않나 합니다!

물론 '온도'와 관련해 이 분야에서 통계물리의 근본력을 이야기하는 데에 한 문단이 통으로 나온 건 여전히 좀 급발진같지만 이것도 용선생 그 자체라 웃음포인트.

@오용재 죄송하다뇨 당치도 않습니다. 이런 좋은 글을 작성해 주시는것만으로도 감사드리죠! 앞으로도 ai 관련해서 많은 좋은 글 작성 부탁드립니다 :)

@messy92 안녕하세요 흥미롭게 읽어주셔서 감사합니다. 지적해주신 점이 맞습니다..! 말씀대로 GPT-3를 학습시킨건 MLM 기반이 아니라고 알고있는데, 구글링해서 찾은 여러 테크블로그 아티클들에서 ChatGPT에 MLM을 썼다고 이야기하길래 ChatGPT를 만드는 파인튜닝 단계에서 그런 걸 썼겠거니 하고 간단히 언급했는데 아마 근거가 부족했던것 같습니다.

실제로 InstructGPT와 ChatGPT 소개 페이지에서도 MLM이 언급되거나 하지는 않기때문에 현재 말씀하신 의심에 대해 정확히 알기는 어려운것 같습니다. 그 테크블로그들에서의 언급은 말씀해주신 의심과 관련이 있다기보다는, 그냥 아마 ChatGPT가 매우 유명해지면서 NLP 전반을 소개하는데, ChatGPT에 대한 specific한 설명과 구분을 잘 안하고 서술했을 뿐인 것 같습니다 (제 글의 해당 부분도 그중 하나이겠고요). 아무튼 좋은 코멘트 주셨는데 다소 허무한 답변이 되어서 죄송합니다.

안녕하세요. ChatGPT를 지탱하는 기술적인 세부요소들에 대해 이런저런 정보를 구하다가 여기까지 찾아왔습니다. 작성해 주신글 매우 재미있게 잘 읽었습니다. 다름이 아니고, 혹시 ChatGPT 구현에 masked language modeling이 활용되었다는 본문 내용의 출처를 알 수 있을까요? 제가 알기로 GPT (Generative Pretrained Transformer)는 autoregressive하게 예측을 수행하는 일반적인 language modeling으로 구현되는 것으로 알고 있습니다. 한편, 이러한 language model을 reinforcement learning (with human feedback)을 통해 reward-signal 기반으로 fine-tuning 할 경우, 그 난이도가 매우 높아 non-autoregressive하게 구현하는 것이 훨씬 수월하고, 따라서 masked language modeling이 선호되는 것으로 알고 있습니다. 이에 따라, 혹시나 ChatGPT의 개발 매커니즘에 내부적으로 masked language modeling이 구현되어 있는 것은 아닌지 의심하던 찰나에 여기까지 흘러들어와 작성자님 글을 보게되었네요.ㅎㅎ 괜찮으시다면 MLM 파트에 대한 출처를 공유해 주시면 감사하겠습니다. :)